A evolução dos modelos de inteligência artificial levou a um crescente interesse nas soluções locais, capazes de oferecer autonomia e controle na interação com os Modelos de Linguagem Grande (MLM). Neste contexto, o MSTY apresenta-se como uma aplicação multiplataforma projetada para simplificar a execução de modelos de código aberto, tanto localmente como online, representando uma opção válida para desenvolvedores e entusiastas ansiosos para explorar o potencial de IA sem a dependência de serviços de nuvem.

MSTY e seus benefícios

MSTY é um aplicativo compatível com sistemas operacionais Windows, Mac e Linux, projetado para facilitar o uso de modelos IA como Llama-2 e DeepSeek Coder. Sua interface intuitiva permite uma configuração rápida, eliminando a necessidade de instalações complexas ou usando a linha de comando. Este recurso o torna particularmente adequado tanto para aqueles que se aproximam do mundo local de IA pela primeira vez, como para usuários experientes que procuram um ambiente de trabalho simplificado.

Um dos principais pontos fortes do MSTY reside na sua capacidade de apoiar LLM local e online, oferecendo aos utilizadores uma flexibilidade considerável. A plataforma permite alternar facilmente entre diferentes modelos, incluindo Mixtral, Llama2, Qwen, GPT-3 e GPT-4, tudo dentro de uma única interface coesa.

A privacidade e a capacidade de operar offline são vantagens significativas adicionais. A execução de modelos locais garante que os dados sensíveis permaneçam confidenciais e acessíveis mesmo na ausência de conexão à internet, respondendo a crescentes preocupações sobre segurança e confidencialidade dos dados.

O MSTY também se destaca por sua interface de usuário intuitiva, que simplifica o processo de interação e refinamento dos textos gerados pela IA, tornando a plataforma acessível a uma ampla gama de usuários, independentemente de seu nível de expertise técnica.

Principais recursos para uso LLM local

MSTY integra diferentes recursos que melhoram o utilitário para executar LLM localmente. O aplicativo facilita o download dos modelos necessários e suporta aceleração via GPU no MacOS, otimizando o desempenho para usuários com hardware compatível. Para aqueles que preferem usar modelos on-line, o MSTY suporta a integração de chaves API, permitindo o acesso a serviços baseados em nuvem quando necessário.

Uma característica proeminente é o apoio aos gasodutos de geração aumentados da recuperação (RAG). Essa habilidade permite que você pesquise e recupere informações de fontes externas de conhecimento, melhorando a capacidade do modelo de fornecer respostas precisas e relevantes para o contexto.

MSTY também oferece recursos avançados, como integração de pesquisa web, chat subdividido e “Modo em profundidade” para uma análise mais detalhada. A plataforma inclui ferramentas como Flowchat e Advanced Branching, úteis para gerenciar conversas complexas e processos de pensamento de forma mais eficaz.

No que diz respeito à proteção da privacidade, o MSTY incorpora o recurso “Context Shield”, concebido para preservar a confidencialidade dos dados durante as interações com IA. O Modo Vapor fornece um nível adicional de segurança para conversas sensíveis.

Preparação do sistema para MSTY

Antes de prosseguir com a instalação do MSTY LLM localmente, é essencial garantir que o sistema cumpra os requisitos necessários para uma instalação suave e um desempenho ideal.

Para usuários do Windows, pelo menos o Windows 10 é necessário. A aplicação requer um mínimo de 8 GB de RAM, com 16 GB recomendado para desempenho superior. Uma moderna CPU multi-core também é necessária para gerenciar requisitos computacionais relacionados à execução de modelos de IA locais.

Embora não seja indispensável, uma placa gráfica dedicada pode melhorar significativamente o desempenho. No MacOS, o MSTY suporta o uso da GPU, acelerando o processamento para várias atividades de inteligência artificial.

É importante garantir que os drivers mais recentes estão instalados no sistema, especialmente para usuários GPU NVIDIA, para o qual é recomendado instalar os drivers CUDA mais recentes para permitir aceleração GPU.

Para otimizar o desempenho, é aconselhável fechar aplicações de fundo desnecessárias. Para modelos mais exigentes, a atualização do hardware, especialmente o GPU VRAM (recomendado 20-24+ GB para modelos com parâmetros 70B), pode ser considerado. No entanto, para modelos menores (por exemplo, 9B), hardware menos poderoso ainda pode fornecer desempenho satisfatório.

O MSTY oferece flexibilidade na escolha de modelos, suportando tanto modelos locais de código aberto como o Llama-2 e o DeepSeek Coder, quanto modelos online através de chaves API para serviços como o OpenAI. A capacidade de operar offline garante privacidade e segurança de dados, tornando-o ideal para o processamento de informações sensíveis ou em ambientes de conectividade restritos.

Guia de Instalação do Passo MSTY

O processo de instalação do MSTY LLM localmente é simples e direto.

- Baixe a versão correta: Visite o site oficial de MSTY e baixar a versão apropriada para o seu sistema operacional (Windows, Mac ou Linux), selecionando a arquitetura correta para usuários do Windows (32 ou 64 bits).

- Execução do Programa de Instalação: Depois de baixar o arquivo, execute-o (duplo clique no Windows) para iniciar o assistente de instalação. No Windows, pode aparecer um alerta do Windows Defender, que pode ser ignorado discretamente. Siga as instruções na tela para concluir a instalação.

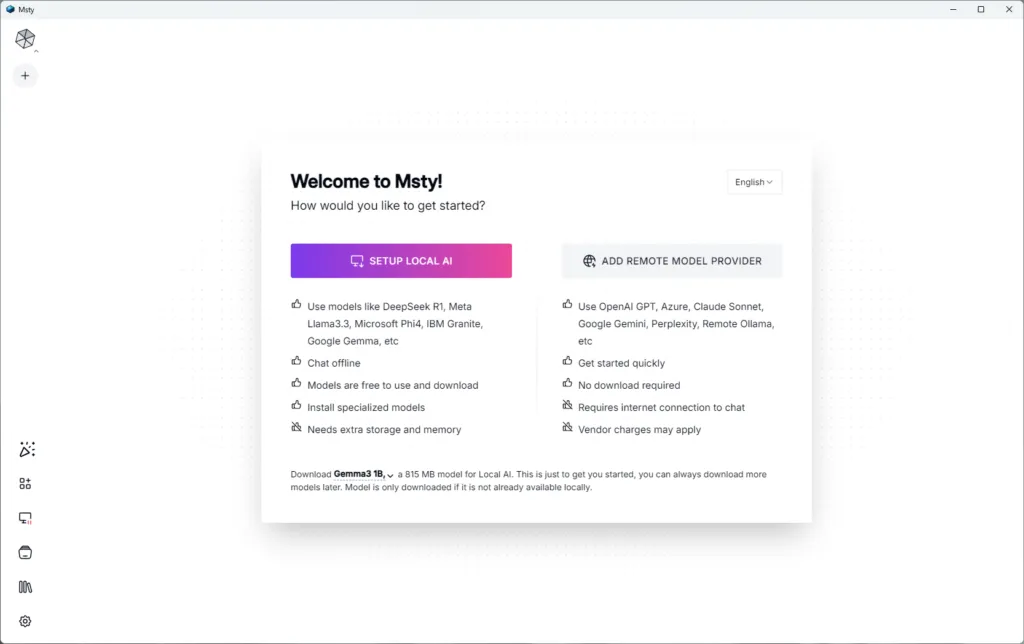

- Configuração pós- instalação: Após a instalação, inicie o MSTY. Serão apresentadas duas opções: “IMPOSTA PARA LOCAL” ou “FORNIER PARA REMOVER MODELOS”. Para começar com os modelos de IA locais, selecione “AI LOCAL SETUP”. Isso começará automaticamente a baixar e instalar os modelos necessários, incluindo tokenizers e configurações de GPU, sem exigir intervenções de linha de comando.

Após a configuração, você pode precisar reiniciar o aplicativo. Uma vez reaberto, você pode começar a explorar recursos do MSTY, incluindo chat offline com modelos IA, garantindo privacidade e segurança de dados.

MSTY também oferece a possibilidade de adicionar arquivos (PDF, CSV, JSON) para criar uma base de conhecimento personalizada e suporta a integração de links do YouTube para extrair transcrições e interagir com conteúdo de vídeo. O aplicativo oferece uma interface intuitiva para baixar e gerenciar diferentes modelos de IA, indicando compatibilidade com seu hardware.

Configuração e Uso dos Locais LLM no MSTY

MSTY simplifica o acesso e uso de modelos de IA locais através da seção “AI local” no menu de aplicação. Aqui está uma lista de modelos para download, com Llama 3 e Lava (para recursos multimodais) como opções recomendadas. A escolha do modelo depende dos requisitos específicos do projeto e dos recursos computacionais disponíveis.

Uma das características distintivas é o apoio aos oleodutos RAG, que permitem criar “pilha de conhecimento”. Para definir uma pilha, clique em "Add your first knowledge stack" e selecione um modelo de incorporação (Snowflake Arctic Embed é atualmente recomendado). Você pode adicionar diferentes tipos de arquivos (PDF, CSV, JSON) e integrar links do YouTube para criar uma base de conhecimento rica e simultaneamente relevante.

Depois de configurar o LLM local e as pilhas de conhecimento, você pode interagir com o modelo de IA através da interface de chat intuitiva do MSTY. O aplicativo oferece recursos como chats divididos e a capacidade de anexar pilhas de conhecimento específicas a conversas.

Para aqueles que querem também usar modelos on-line, o MSTY permite que você adicione chaves API para serviços como OpenAI, Gemini e Anthropic, oferecendo flexibilidade na escolha do modelo de acordo com suas necessidades e requisitos de privacidade.

A interface também inclui recursos avançados, como “Modo de revelação” e “Escudo de contexto” para uma experiência IA mais segura e personalizável.