Nel panorama dell’IT moderno, la transizione dalle architetture monolitiche ai microservizi ha ridefinito il modo in cui il software viene sviluppato e distribuito. In questo contesto, Kubernetes e Docker emergono non come tecnologie concorrenti, ma come componenti complementari di un ecosistema cloud-native. Per comprendere come ottimizzare un’infrastruttura IT, è essenziale distinguere chiaramente i ruoli di queste due tecnologie: la containerizzazione e l’orchestrazione.

Il ruolo della Containerizzazione: Docker

Docker ha rivoluzionato lo sviluppo software risolvendo il classico problema del “funziona sulla mia macchina ma non in produzione”. Docker è una tecnologia di runtime che consente agli sviluppatori di creare, distribuire ed eseguire applicazioni all’interno di container.

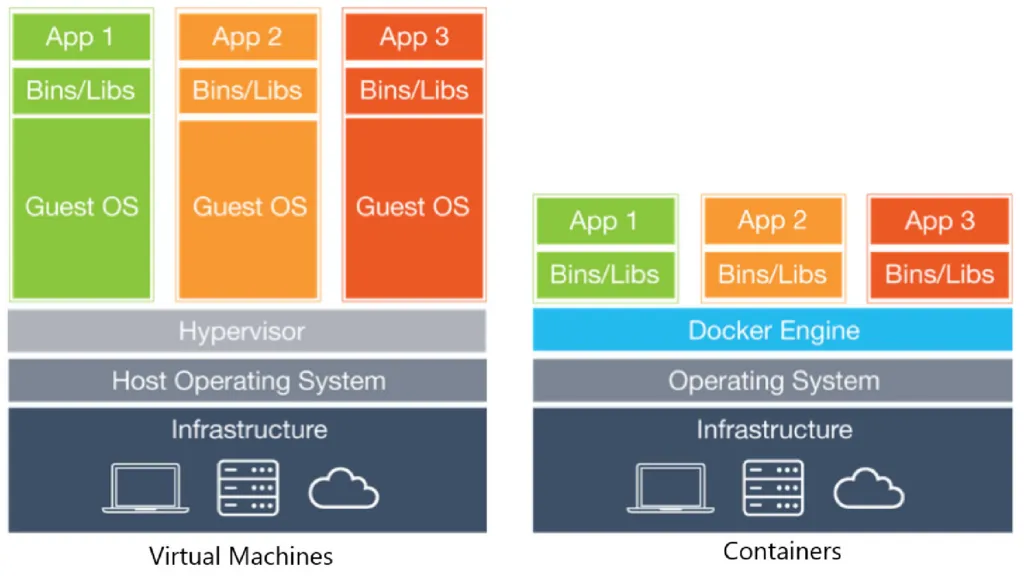

Un container è un’unità standardizzata che impacchetta il codice insieme a tutte le sue dipendenze (librerie, runtime, strumenti di sistema). Questo garantisce l’isolamento dei processi e la portabilità assoluta: un container Docker si comporta esattamente allo stesso modo su un laptop di sviluppo, su un server on-premise o su un’istanza cloud.

Un diagramma a strati che mostra la differenza tra “Virtual Machines” (con Guest OS pesante) e “Containers” (che condividono il kernel dell’host tramite il Docker Engine).

Gli strumenti chiave dell’ecosistema Docker includono:

- Docker Engine: Il motore che rende possibile l’esecuzione dei container.

- Dockerfile e Build: I comandi per definire le specifiche dell’immagine container.

- Docker Hub: Un registro per condividere e reperire immagini, analogo a un repository di codice.

La necessità dell’Orchestrazione: Kubernetes

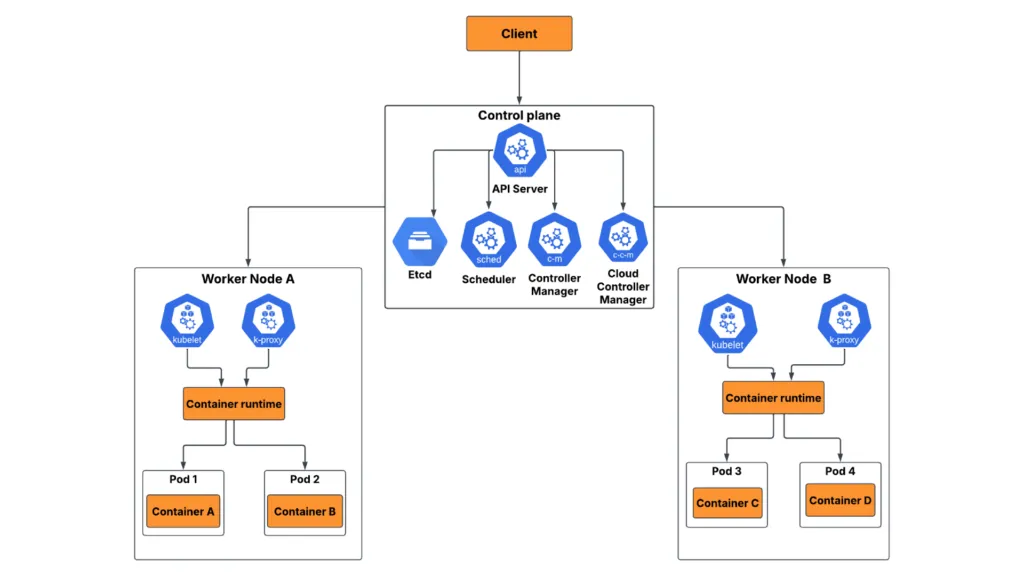

Se Docker rappresenta il “mattone” fondamentale, Kubernetes (spesso abbreviato in K8s) è l’architetto che utilizza quei mattoni per costruire e gestire strutture complesse. Quando un’applicazione enterprise è composta da centinaia o migliaia di container distribuiti su diversi server, la gestione manuale diventa impossibile.

Kubernetes è una piattaforma open-source di orchestrazione che automatizza le operazioni operative (Ops) dei container. Non si limita a eseguire l’applicazione, ma ne garantisce lo stato desiderato attraverso:

- Service Discovery e Load Balancing: Distribuzione intelligente del traffico di rete tra i container.

- Self-healing: Riavvio automatico dei container che falliscono o sostituzione dei nodi non rispondenti.

- Scaling Automatico: Aumento o diminuzione del numero di container attivi (Pod) in base al carico della CPU o della memoria.

Uno schema architetturale di un Cluster Kubernetes. Al centro il “Control Plane” (il cervello) che gestisce diversi “Worker Nodes”, all’interno dei quali si vedono molteplici icone di Docker/Container raggruppate in “Pod”.

Un’analogia funzionale: L’Orchestra

Per visualizzare meglio la differenza, si può ricorrere all’analogia musicale.

- Docker è il musicista: È focalizzato sulla performance del singolo strumento (il microservizio). Assicura che la sua parte sia eseguita perfettamente, con il giusto strumento e spartito (librerie e codice).

- Kubernetes è il direttore d’orchestra: Non suona gli strumenti, ma coordina l’intero gruppo. Decide quando un musicista deve iniziare a suonare, quanto volume (risorse) deve utilizzare, e se un musicista sta male (crash del sistema), ne chiama immediatamente un sostituto per non interrompere la sinfonia.

Integrazione e Gestione nel Cloud (AWS)

L’adozione di queste tecnologie è spesso facilitata dai provider cloud come Amazon Web Services (AWS), che offrono servizi gestiti per ridurre la complessità infrastrutturale.

Le aziende possono scegliere tra due percorsi principali su AWS:

- Amazon Elastic Kubernetes Service (EKS): Ideale per chi ha già competenze su Kubernetes o necessita di migrare carichi di lavoro da altri ambienti K8s. AWS gestisce la complessità del piano di controllo, garantendo alta affidabilità.

- Amazon Elastic Container Service (ECS): Una soluzione alternativa a Kubernetes, fortemente integrata nell’ecosistema AWS. ECS è spesso preferito per la sua semplicità operativa quando non sono richieste le funzionalità di personalizzazione estrema di Kubernetes.

L’Impatto Strategico sull’IT

La vera potenza di un’architettura moderna non risiede nella scelta tra Docker e Kubernetes, ma nella loro combinazione. Docker standardizza il rilascio del software, accelerando il time-to-market per gli sviluppatori. Kubernetes garantisce che quel software sia resiliente, scalabile ed efficiente dal punto di vista delle risorse per il team operativo.

Adottare questa sinergia significa trasformare l’IT da un centro di costo statico a un asset dinamico, capace di adattarsi in tempo reale alle esigenze del business e di supportare applicazioni distribuite su scala globale con livelli di disponibilità precedentemente irraggiungibili.