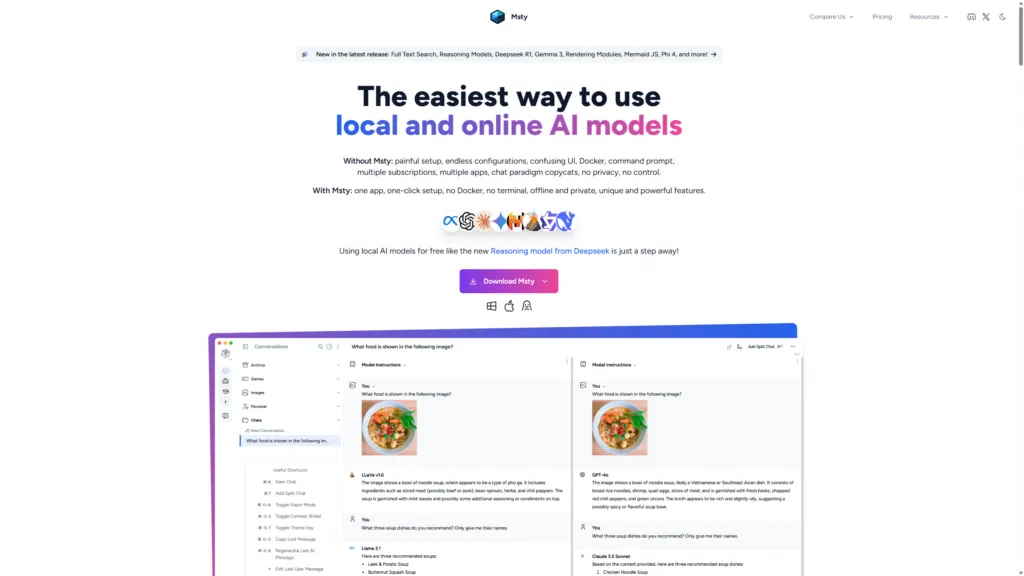

L'évolution des modèles d'intelligence artificielle a suscité un intérêt croissant pour les solutions locales, capables d'offrir autonomie et contrôle dans l'interaction avec les grands modèles linguistiques (LLM). Dans ce contexte, MSTY se présente comme une application multiplateforme conçue pour simplifier l'exécution des modèles open source, localement et en ligne, ce qui représente une option valable pour les développeurs et les passionnés désireux d'explorer le potentiel de l'IA sans dépendre des services cloud.

MSTY et vos avantages

MSTY est une application compatible avec les systèmes d'exploitation Windows, Mac et Linux, conçue pour faciliter l'utilisation de modèles IA tels que Llama-2 et DeepSeek Coder. Son interface intuitive permet une configuration rapide, éliminant le besoin d'installations complexes ou en utilisant la ligne de commande. Cette fonctionnalité le rend particulièrement adapté à la fois pour ceux qui s'approchent du monde local de l'IA pour la première fois, et pour les utilisateurs expérimentés à la recherche d'un environnement de travail simplifié.

L'une des principales forces de MSTY réside dans sa capacité à soutenir le LLM local et en ligne, offrant aux utilisateurs une flexibilité considérable. La plate-forme vous permet de basculer facilement entre différents modèles, y compris Mixtral, Lama2, Qwen, GPT-3 et GPT-4, tous dans une seule interface cohésive.

La protection de la vie privée et la capacité de fonctionner hors ligne sont des avantages importants supplémentaires. L'exécution de modèles locaux garantit que les données sensibles restent confidentielles et accessibles même en l'absence de connexion Internet, répondant ainsi aux préoccupations croissantes concernant la sécurité et la confidentialité des données.

MSTY se distingue également par son interface utilisateur intuitive, qui simplifie le processus d'interaction et de raffinement des textes générés par l'IA, rendant la plateforme accessible à un large éventail d'utilisateurs, quel que soit leur niveau d'expertise technique.

Caractéristiques clés de l'utilisation locale de LLM

MSTY intègre différentes fonctionnalités qui améliorent l'utilité pour exécuter LLM localement. L'application facilite le téléchargement des modèles nécessaires et prend en charge l'accélération via GPU sur MacOS, optimisant les performances pour les utilisateurs avec du matériel compatible. Pour ceux qui préfèrent utiliser des modèles en ligne, MSTY prend en charge l'intégration des clés API, permettant l'accès aux services basés sur le cloud au besoin.

Une caractéristique importante est le soutien pour les pipelines de production augmentés de récupération (RAG). Cette capacité vous permet de rechercher et de récupérer de l'information à partir de sources externes de connaissances, améliorant ainsi la capacité du modèle à fournir des réponses précises et pertinentes au contexte.

MSTY offre également des fonctionnalités avancées telles que l'intégration de la recherche sur le Web, le chat subdivisé et le mode approfondi pour une analyse plus détaillée. La plateforme comprend des outils tels que Flowchat et Advanced Branching, utiles pour gérer plus efficacement les conversations complexes et les processus de pensée.

Pour ce qui est de la protection de la vie privée, MSTY intègre la fonction «Context Shield» conçue pour préserver la confidentialité des données lors des interactions avec l'IA. Le mode Vapor offre un niveau de sécurité supplémentaire pour les conversations sensibles.

Préparation du système pour MSTY

Avant de procéder à l'installation de MSTY LLM localement, il est essentiel de s'assurer que le système répond aux exigences requises pour une installation en douceur et une performance optimale.

Pour les utilisateurs de Windows, au moins Windows 10 est nécessaire. L'application nécessite un minimum de 8 Go de RAM, avec 16 Go recommandé pour des performances supérieures. Un processeur multicore moderne est également nécessaire pour gérer les exigences de calcul liées à l'exécution des modèles locaux d'IA.

Bien qu'il ne soit pas indispensable, une carte graphique dédiée peut améliorer considérablement les performances. Sur MacOS, MSTY soutient l'utilisation de GPU, accélérant le traitement pour diverses activités d'intelligence artificielle.

Il est important de s'assurer que les derniers pilotes sont installés sur le système, en particulier pour les utilisateurs GPU NVIDIA, pour lequel il est recommandé d'installer les derniers pilotes CUDA pour permettre l'accélération GPU.

Pour optimiser les performances, il est conseillé de fermer les applications de fond inutiles. Pour les modèles plus exigeants, la mise à jour du matériel, en particulier le GPU VRAM (recommandation 20-24+ GB pour les modèles avec des paramètres 70B), peut être considéré. Toutefois, pour les modèles plus petits (p. ex. 9B), le matériel moins puissant peut encore fournir des performances satisfaisantes.

MSTY offre une flexibilité dans le choix des modèles, supportant à la fois les modèles open source locaux tels que Llama-2 et DeepSeek Coder, et les modèles en ligne via des clés API pour des services comme OpenAI. La capacité de fonctionner hors ligne assure la confidentialité et la sécurité des données, ce qui la rend idéale pour le traitement d'informations sensibles ou dans des environnements de connectivité restreinte.

MSTY Guide d'installation étape

Le processus d'installation de MSTY LLM localement est simple et direct.

- Télécharger la version correcte: Visitez le site officiel de MSTY et télécharger la version appropriée pour votre système d'exploitation (Windows, Mac ou Linux), en sélectionnant l'architecture correcte pour les utilisateurs de Windows (32 ou 64 bits).

- Exécution du programme d'installation : Une fois que vous téléchargez le fichier, exécutez-le (double-cliquez sur Windows) pour démarrer l'assistant d'installation. Sur Windows, une alerte Windows Defender peut apparaître, qui peut être discrètement ignorée. Suivez les instructions à l'écran pour terminer l'installation.

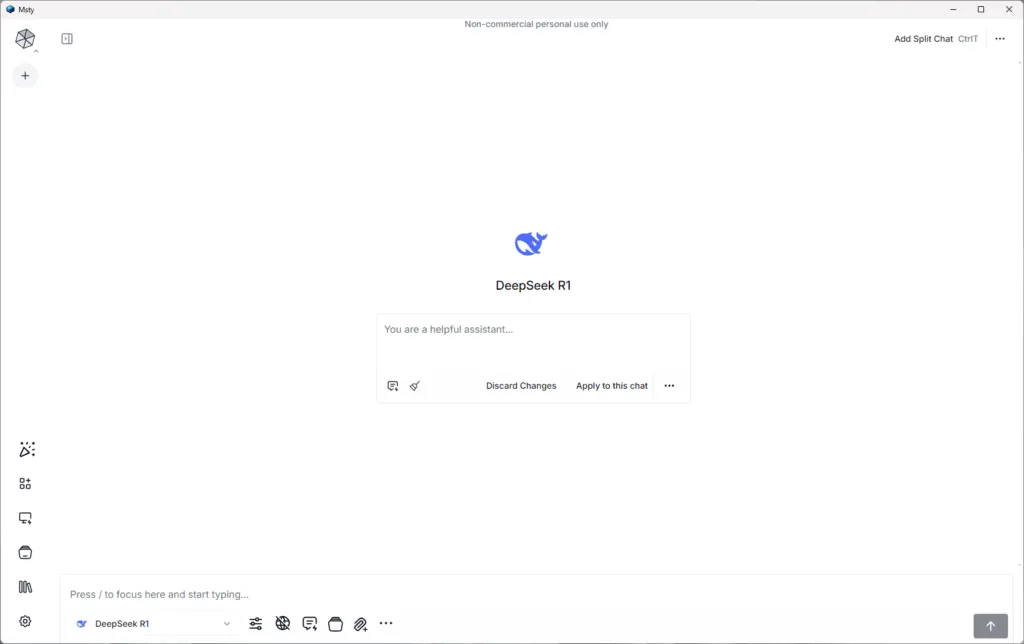

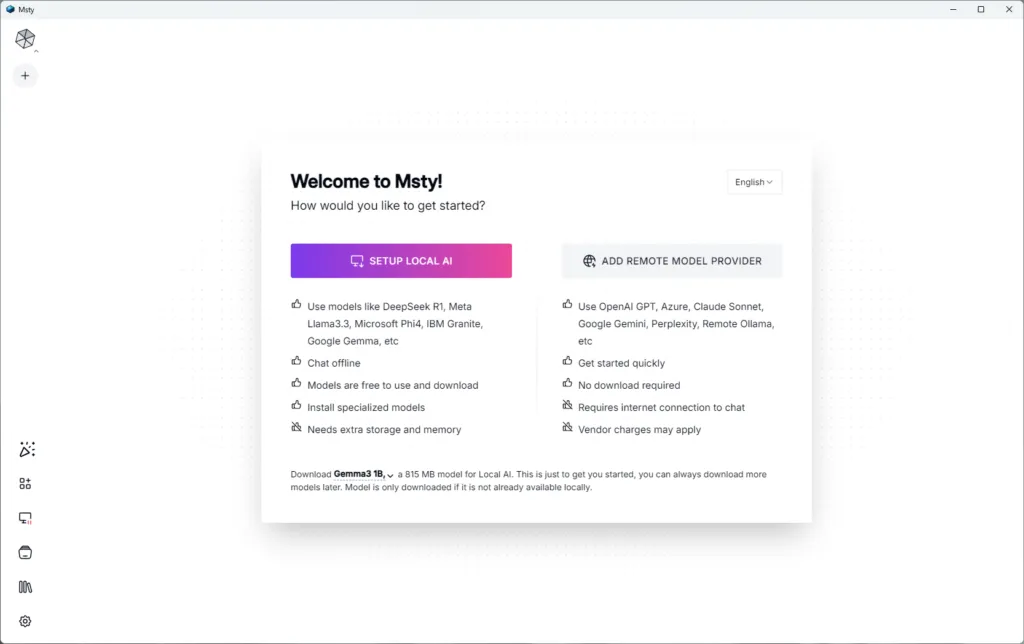

- Configuration post-installation: Après installation, démarrez MSTY. Deux options seront présentées: Impulser à LOCAL ou à FORNIER pour supprimer les modèles. Pour commencer avec les modèles locaux d'IA, sélectionnez « SETUP LOCAL AI ». Cela va automatiquement commencer à télécharger et installer les modèles nécessaires, y compris les tokenizers et les paramètres GPU, sans nécessiter des interventions en ligne de commande.

Après la configuration, vous devrez peut-être redémarrer l'application. Une fois rouvert, vous pouvez commencer à explorer les fonctionnalités MSTY, y compris le chat hors ligne avec les modèles IA, assurant la confidentialité et la sécurité des données.

MSTY offre également la possibilité d'ajouter des fichiers (PDF, CSV, JSON) pour créer une base de connaissances personnalisée et prend en charge l'intégration de liens YouTube pour extraire des transcriptions et interagir avec le contenu vidéo. L'application fournit une interface intuitive pour télécharger et gérer différents modèles IA, indiquant la compatibilité avec votre matériel.

Configuration et utilisation des locaux LLM dans MSTY

MSTY simplifie l'accès et l'utilisation des modèles IA locaux par l'intermédiaire de la section IA du menu Application. Voici une liste de modèles téléchargeables, avec Lama 3 et Lava (pour les fonctionnalités multimodales) comme options recommandées. Le choix du modèle dépend des exigences spécifiques du projet et des ressources informatiques disponibles.

L'une des caractéristiques distinctives est le support des pipelines RAG, qui permettent de créer des piles de connaissances. Pour définir une pile, cliquez sur Ajouter votre première pile de connaissances et sélectionnez un modèle d'intégration (Snowflake Arctic Embed est actuellement recommandé). Vous pouvez ajouter différents types de fichiers (PDF, CSV, JSON) et intégrer des liens YouTube pour créer une base de connaissances riche et pertinente simultanément.

Une fois que vous avez configuré les piles locales LLM et connaissances, vous pouvez interagir avec le modèle AI via l'interface intuitive MSTY chat. L'application offre des fonctionnalités telles que des conversations fractionnées et la possibilité d'attacher des piles de connaissances spécifiques aux conversations.

Pour ceux qui veulent également utiliser des modèles en ligne, MSTY vous permet d'ajouter des clés API pour des services comme OpenAI, Gemini et Anthropic, offrant une flexibilité dans le choix du modèle en fonction de vos besoins et exigences de confidentialité.

L'interface inclut également des fonctionnalités avancées telles que le mode de navigation -Delve et -Context Shield pour une expérience IA plus sécurisée et personnalisable.