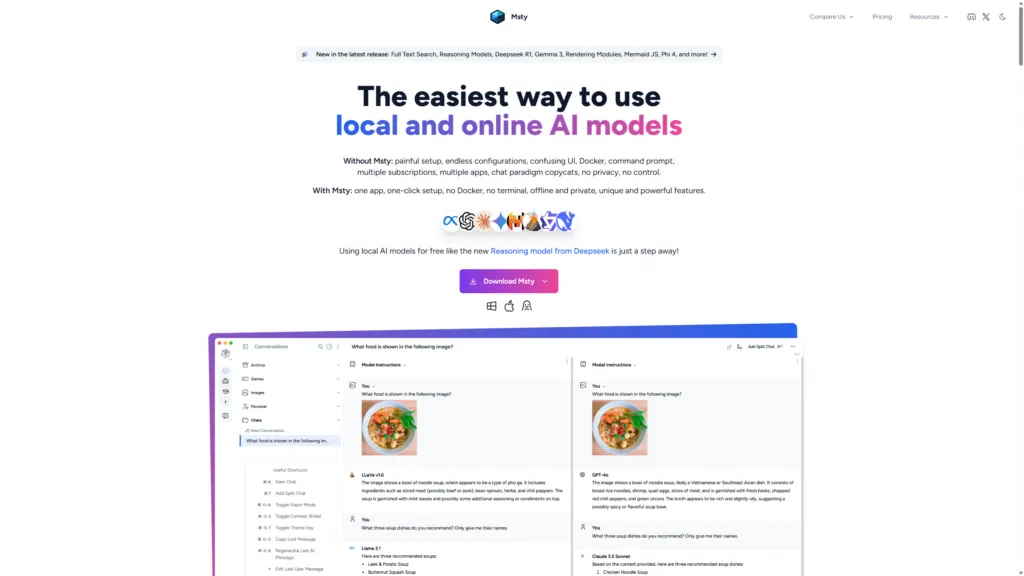

La evolución de los modelos de inteligencia artificial ha generado un creciente interés en las soluciones locales, capaces de ofrecer autonomía y control en la interacción con los modelos de lenguajes grandes (LLM). En este contexto, MSTY se presenta como una aplicación multiplataforma diseñada para simplificar la ejecución de modelos de código abierto, tanto local como online, representando una opción válida para desarrolladores y entusiastas deseosos de explorar el potencial de AI sin la dependencia de los servicios en la nube.

MSTY y sus beneficios

MSTY es una aplicación compatible con sistemas operativos Windows, Mac y Linux, diseñados para facilitar el uso de modelos IA como Llama-2 y DeepSeek Coder. Su interfaz intuitiva permite una configuración rápida, eliminando la necesidad de instalaciones complejas o utilizando la línea de comandos. Esta característica lo hace particularmente adecuado tanto para aquellos que se acercan al mundo local de IA por primera vez, como para los usuarios experimentados que buscan un ambiente de trabajo simplificado.

Una de las principales fortalezas del MSTY radica en su capacidad de apoyar el LLM local y en línea, ofreciendo a los usuarios una flexibilidad considerable. La plataforma le permite cambiar fácilmente entre diferentes modelos, incluyendo Mixtral, Llama2, Qwen, GPT-3 y GPT-4, todo dentro de una única interfaz cohesiva.

La privacidad y la capacidad de operar fuera de línea son ventajas significativas adicionales. La ejecución de modelos locales garantiza que los datos confidenciales sigan siendo confidenciales y accesibles incluso en ausencia de conexión a Internet, respondiendo a crecientes preocupaciones acerca de la seguridad de los datos y la confidencialidad.

MSTY también destaca por su intuitiva interfaz de usuario, que simplifica el proceso de interacción y refinamiento de textos generados por AI, haciendo que la plataforma sea accesible a una amplia gama de usuarios, independientemente de su nivel de experiencia técnica.

Características clave para el uso local de LLM

MSTY integra diferentes características que mejoran la utilidad para ejecutar LLM localmente. La aplicación facilita la descarga de los modelos necesarios y permite la aceleración a través de GPU en MacOS, optimizando el rendimiento para los usuarios con hardware compatible. Para aquellos que prefieren usar modelos en línea, MSTY apoya la integración de claves de API, permitiendo el acceso a servicios basados en la nube cuando sea necesario.

Una característica prominente es el apoyo a los oleoductos de generación aumentados de la recuperación (RAG). Esta capacidad le permite buscar y recuperar información de fuentes externas de conocimiento, mejorando la capacidad del modelo para proporcionar respuestas precisas y relevantes al contexto.

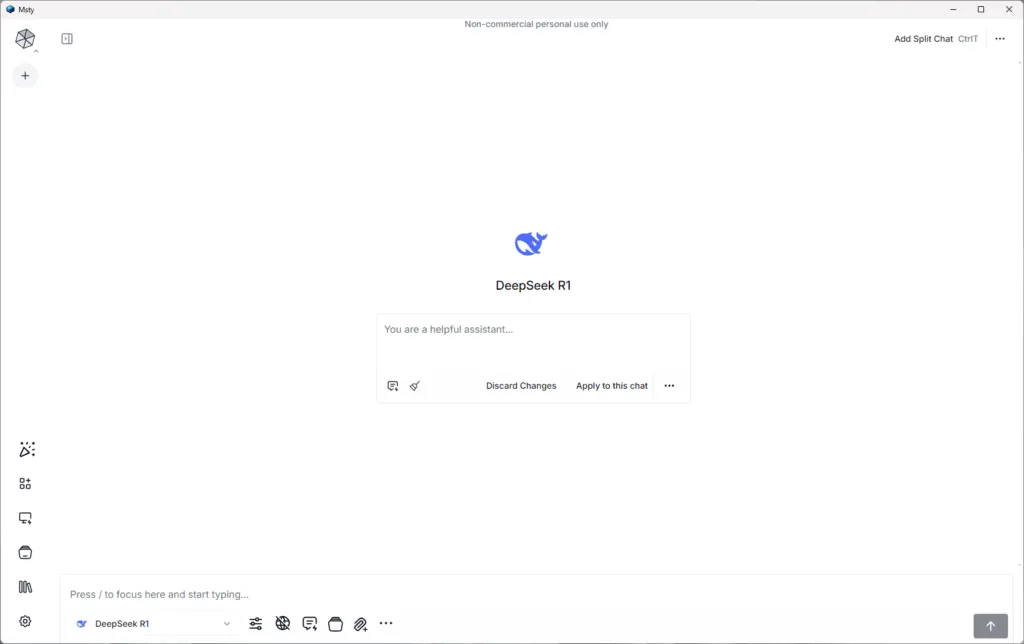

MSTY también ofrece características avanzadas como la integración de la búsqueda web, chat subdividido y “Modo en profundidad” para un análisis más detallado. La plataforma incluye herramientas como Flowchat y Advanced Branching, útiles para gestionar conversaciones complejas y procesos de pensamiento más eficazmente.

En cuanto a la protección de la privacidad, MSTY incorpora la función “Context Shield”, diseñada para preservar la confidencialidad de los datos durante las interacciones con AI. El modo Vapor proporciona un nivel adicional de seguridad para conversaciones sensibles.

Preparación de sistemas para MSTY

Antes de continuar con la instalación de MSTY LLM localmente, es esencial asegurar que el sistema cumpla los requisitos necesarios para una instalación suave y un rendimiento óptimo.

Para los usuarios de Windows, al menos Windows 10 es necesario. La aplicación requiere un mínimo de 8 GB de RAM, con 16 GB recomendados para un rendimiento superior. También se necesita una CPU multi-core moderna para gestionar los requisitos computacionales relacionados con la ejecución de los modelos locales de IA.

Aunque no es indispensable, una tarjeta gráfica dedicada puede mejorar significativamente el rendimiento. En MacOS, MSTY apoya el uso de GPU, acelerando el procesamiento para diversas actividades de inteligencia artificial.

Es importante asegurar que los últimos controladores estén instalados en el sistema, especialmente para los usuarios de GPU NVIDIA, para lo que se recomienda instalar los últimos controladores CUDA para permitir la aceleración de GPU.

Para optimizar el rendimiento, es recomendable cerrar aplicaciones de fondo sin necesidad. Para modelos más exigentes, la actualización del hardware, especialmente el GPU VRAM (recomendado 20-24+ GB para modelos con parámetros 70B), se puede considerar. Sin embargo, para modelos más pequeños (por ejemplo 9B), hardware menos potente todavía puede proporcionar un rendimiento satisfactorio.

MSTY ofrece flexibilidad en la selección de modelos, soportando tanto modelos locales de código abierto como Llama-2 y DeepSeek Coder, y modelos en línea a través de claves API para servicios como OpenAI. La capacidad de operar fuera de línea garantiza la privacidad y la seguridad de los datos, lo que lo hace ideal para procesar información confidencial o en entornos de conectividad restringidos.

Guía de instalación de MSTY Step

El proceso de instalación de MSTY LLM localmente es simple y directo.

- Descargar la versión correcta: Visita el sitio web oficial MSTY y descargar la versión adecuada para su sistema operativo (Windows, Mac o Linux), seleccionando la arquitectura correcta para los usuarios de Windows (32 o 64 bits).

- Ejecución del Programa de Instalación: Una vez que descargue el archivo, ejecute (clic doble Windows) para iniciar el asistente de instalación. En Windows puede aparecer una alerta de Windows Defender, que puede ser ignorada silenciosamente. Siga las instrucciones en pantalla para completar la instalación.

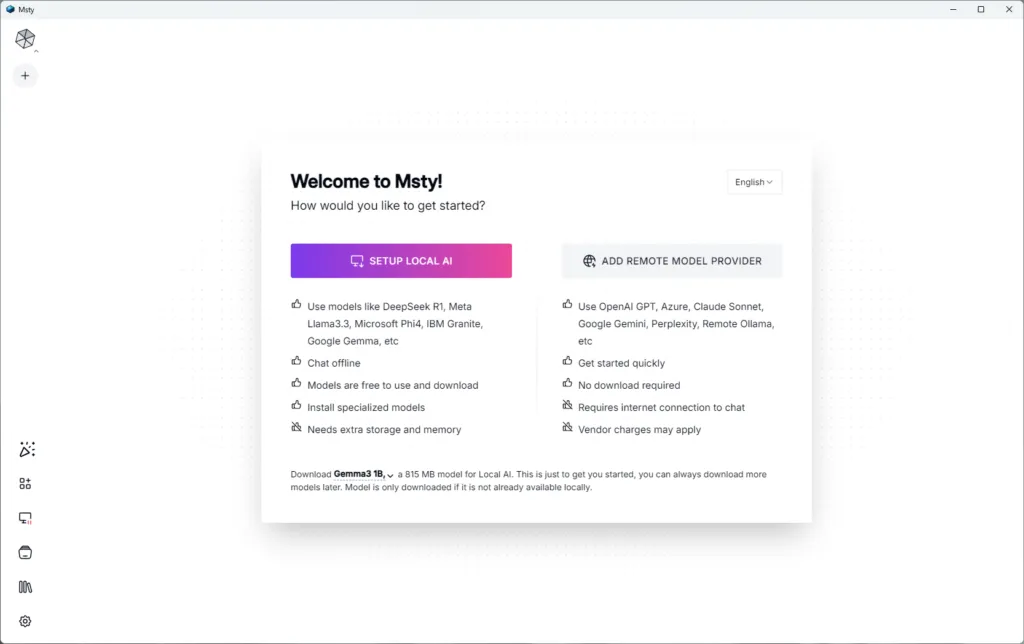

- Configuración posterior a la instalación: Después de la instalación, inicie MSTY. Se presentarán dos opciones: “IMPOST TO LOCAL” o “FORNIER TO REMOVE MODELOS”. Para empezar con los modelos locales de IA, seleccione “SETUP LOCAL AI”. Esto comenzará automáticamente a descargar e instalar los modelos necesarios, incluyendo tokenizers y ajustes de GPU, sin requerir intervenciones de línea de comandos.

Después de la configuración, es posible que necesite reiniciar la aplicación. Una vez renovado, puede comenzar a explorar las características de MSTY, incluyendo el chat sin conexión con los modelos IA, garantizando la privacidad y seguridad de datos.

MSTY también ofrece la posibilidad de añadir archivos (PDF, CSV, JSON) para crear una base de conocimiento personalizada y apoya la integración de enlaces de YouTube para extraer transcripciones e interactuar con contenido de vídeo. La aplicación proporciona una interfaz intuitiva para descargar y gestionar diferentes modelos de IA, indicando compatibilidad con su hardware.

Configuración y uso de LLM Locals en MSTY

MSTY simplifica el acceso y el uso de modelos locales de IA a través de la sección “I local” en el menú de aplicación. Aquí está una lista de modelos descargables, con Llama 3 y Lava (para características multimodales) como opciones recomendadas. La elección del modelo depende de los requisitos específicos del proyecto y de los recursos computacionales disponibles.

Una de las características distintivas es el soporte para los oleoductos RAG, que permiten crear “apilación de conocimiento”. Para configurar una pila, haga clic en "Agregar su primera pila de conocimientos" y seleccione una plantilla de embedding (Snowflake Arctic Embed is currently recommended). Puede agregar diferentes tipos de archivos (PDF, CSV, JSON) e integrar enlaces de YouTube para crear una base de conocimientos rica y simultáneamente relevante.

Una vez que configuras las pilas locales de LLM y conocimiento, puedes interactuar con el modelo AI a través de la interfaz de chat intuitiva de MSTY. La aplicación ofrece características tales como chats divididos y la capacidad de adjuntar pilas de conocimientos específicos a conversaciones.

Para aquellos que quieran utilizar también modelos en línea, MSTY le permite añadir claves API para servicios como OpenAI, Gemini y Anthropic, ofreciendo flexibilidad para elegir el modelo según sus necesidades y requisitos de privacidad.

La interfaz también incluye características avanzadas como “Modo de Deslve” y “Escudo de contexto” para una experiencia de IA más segura y personalizable.