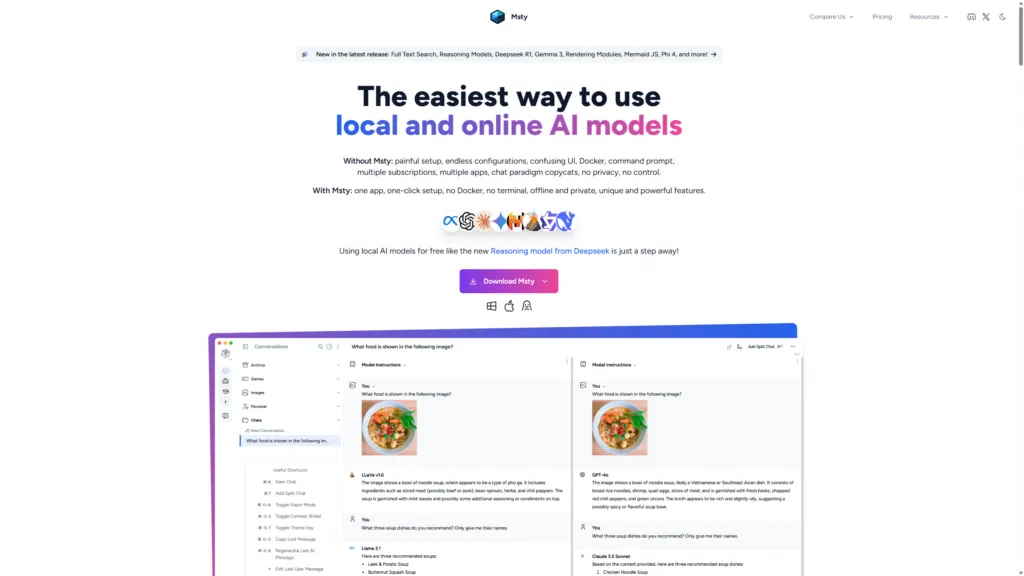

Die Entwicklung von künstlichen Intelligenz-Modellen hat zu einem wachsenden Interesse an lokalen Lösungen geführt, in der Lage, Autonomie und Kontrolle in der Interaktion mit Large Language Models (LLM) bieten. In diesem Zusammenhang präsentiert sich MSTY als Multiplatform-Applikation, die die Ausführung von Open Source-Modellen sowohl lokal als auch online vereinfacht und eine gültige Option für Entwickler und Enthusiasten darstellt, die das Potenzial von AI ohne die Abhängigkeit von Cloud-Diensten erkunden möchten.

MSTY und Ihre Vorteile

MSTY ist eine mit Windows-, Mac- und Linux-Betriebssystemen kompatible Anwendung, die den Einsatz von IA-Modellen wie Llama-2 und DeepSeek Coder erleichtert. Seine intuitive Benutzeroberfläche ermöglicht eine schnelle Konfiguration, die Notwendigkeit komplexer Installationen oder die Verwendung der Befehlszeile. Diese Funktion eignet sich besonders für beide, die sich erstmals der lokalen KI-Welt nähern, und für erfahrene Anwender, die ein vereinfachtes Arbeitsumfeld suchen.

Eine der wichtigsten Stärken von MSTY liegt in seiner Fähigkeit, sowohl lokale als auch online LLM zu unterstützen, bietet den Nutzern erhebliche Flexibilität. Die Plattform ermöglicht es Ihnen, einfach zwischen verschiedenen Modellen zu wechseln, darunter Mixtral, Llama2, Qwen, GPT-3 und GPT-4, alles innerhalb einer einzigen zusammenhängenden Schnittstelle.

Datenschutz und die Möglichkeit, offline zu arbeiten, sind weitere wesentliche Vorteile. Die Ausführung lokaler Modelle stellt sicher, dass sensible Daten auch in Abwesenheit von Internetverbindung vertraulich und zugänglich bleiben und auf steigende Bedenken bezüglich Datensicherheit und Vertraulichkeit reagieren.

MSTY zeichnet sich auch durch eine intuitive Benutzeroberfläche aus, die den Prozess der Interaktion und Verfeinerung von durch AI erzeugten Texten vereinfacht und die Plattform unabhängig von ihrem technischen Know-how für eine breite Palette von Anwendern zugänglich macht.

Schlüsselfunktionen für lokale LLM-Nutzung

MSTY integriert verschiedene Funktionen, die das Dienstprogramm für den Betrieb von LLM lokal verbessern. Die Anwendung erleichtert das Herunterladen der notwendigen Modelle und unterstützt die Beschleunigung über GPU auf MacOS, optimiert die Leistung für Benutzer mit kompatibler Hardware. Für diejenigen, die Online-Modelle bevorzugen, unterstützt MSTY die Integration von API-Schlüsseln und ermöglicht den Zugriff auf Cloud-basierte Dienste bei Bedarf.

Ein prominentes Merkmal ist die Unterstützung für die Erzeugung Pipelines aus der Erholung (RAG). Diese Fähigkeit ermöglicht es Ihnen, Informationen aus externen Wissensquellen zu suchen und abzurufen und die Fähigkeit des Modells zu verbessern, genaue und relevante Antworten auf den Kontext zu liefern.

MSTY bietet auch erweiterte Funktionen wie die Integration von Web-Suche, unterteiltem Chat und “In-Tiefen-Modus” für eine detailliertere Analyse. Die Plattform umfasst Werkzeuge wie Flowchat und Advanced Branching, nützlich für die Verwaltung komplexer Gespräche und Denkprozesse effektiver.

Im Hinblick auf den Datenschutz beinhaltet MSTY die Funktion „Context Shield“, die die Datensicherheit während der Interaktionen mit AI bewahrt. Der Vapor Mode bietet ein zusätzliches Sicherheitsniveau für sensible Gespräche.

Systemvorbereitung für MSTY

Vor der Installation von MSTY LLM vor Ort ist es wichtig, sicherzustellen, dass das System die Anforderungen für eine reibungslose Installation und optimale Leistung erfüllt.

Für Windows-Benutzer ist mindestens Windows 10 erforderlich. Die Anwendung erfordert ein Minimum von 8 GB RAM, mit 16 GB empfohlen für überlegene Leistung. Eine moderne Multi-Core-CPU ist auch erforderlich, um Rechenanforderungen im Zusammenhang mit der Ausführung lokaler IA-Modelle zu verwalten.

Eine dedizierte Grafikkarte kann zwar nicht unbedingt die Leistung verbessern. Auf MacOS unterstützt MSTY die Verwendung von GPU, beschleunigt die Verarbeitung für verschiedene künstliche Intelligenz Aktivitäten.

Es ist wichtig sicherzustellen, dass die neuesten Treiber auf dem System installiert werden, insbesondere für GPU NVIDIA-Nutzer, für die es empfohlen wird, die neuesten CUDA-Treiber zu installieren, um die GPU-Beschleunigung zu ermöglichen.

Um die Leistung zu optimieren, ist es ratsam, unbenötigte Hintergrundanwendungen zu schließen. Für anspruchsvollere Modelle, das Update der Hardware, vor allem das GPU VRAM (empfohlen 20-24+ GB für Modelle mit 70B-Parametern), kann berücksichtigt werden. Für kleinere Modelle (z.B. 9B) kann die weniger leistungsfähige Hardware dennoch eine befriedigende Leistung bieten.

MSTY bietet Flexibilität bei der Auswahl von Modellen und unterstützt sowohl lokale Open Source-Modelle wie Llama-2 und DeepSeek Coder als auch Online-Modelle über API-Schlüssel für Dienste wie OpenAI. Die Fähigkeit, offline zu betreiben, sorgt für Datenschutz und Datensicherheit, so dass es ideal für die Verarbeitung sensibler Informationen oder in eingeschränkten Konnektivitätsumgebungen.

MSTY Step Installation Anleitung

Der Installationsprozess von MSTY LLM lokal ist einfach und direkt.

- Laden Sie die richtige Version herunter: Besuchen Sie die offizielle Website von MST und laden Sie die entsprechende Version für Ihr Betriebssystem herunter (Windows, Mac oder Linux), wählen Sie die richtige Architektur für Windows-Benutzer (32 oder 64 Bit).

- Ausführung des Installationsprogramms: Sobald Sie die Datei herunterladen, starten Sie sie (Doppelklicken Sie auf Windows), um den Installationsassistenten zu starten. Unter Windows kann eine Windows Defender-Benachrichtigung angezeigt werden, die ruhig ignoriert werden kann. Folgen Sie den Anweisungen auf dem Bildschirm, um die Installation abzuschließen.

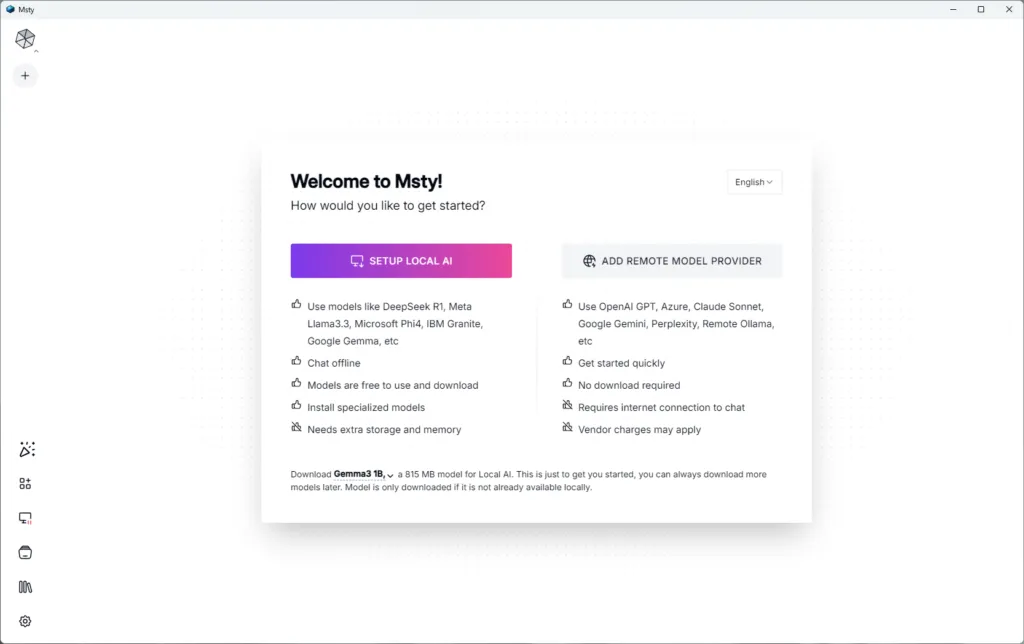

- Post-Installation Konfiguration: Nach der Installation starten Sie MSTY. Zwei Optionen werden vorgestellt: „IMPOST TO LOCAL“ oder „FORNIER TO REMOVE MODELS“. Um mit lokalen IA-Modellen zu beginnen, wählen Sie “SETUP LOCAL AI”. Dies beginnt automatisch mit dem Herunterladen und Installieren der notwendigen Modelle, einschließlich Tokenizer und GPU-Einstellungen, ohne dass Kommandozeileneingriffe erforderlich sind.

Nach der Konfiguration müssen Sie möglicherweise die Anwendung neu starten. Sobald Sie wieder geöffnet sind, können Sie mit der Erkundung von MSTY-Funktionen beginnen, einschließlich Offline-Chat mit IA-Modellen, um Datenschutz und Datensicherheit zu gewährleisten.

MSTY bietet auch die Möglichkeit, Dateien (PDF, CSV, JSON) hinzuzufügen, um eine benutzerdefinierte Wissensbasis zu erstellen und unterstützt die Integration von YouTube-Links, um Transkriptionen zu extrahieren und mit Videoinhalten zu interagieren. Die Anwendung bietet eine intuitive Schnittstelle zum Herunterladen und Verwalten verschiedener IA-Modelle, die die Kompatibilität mit Ihrer Hardware anzeigt.

Konfiguration und Nutzung von LLM Locals in MSTY

MSTY vereinfacht den Zugriff und die Verwendung lokaler IA-Modelle durch den Abschnitt "lokale KI" im Anwendungsmenü. Hier eine Liste der herunterladbaren Modelle, mit Llama 3 und Lava (für multimodale Funktionen) als empfohlene Optionen. Die Wahl des Modells hängt von den spezifischen Anforderungen des Projekts und den verfügbaren Rechenressourcen ab.

Eines der Besonderheiten ist die Unterstützung für die RAG-Pipelines, die es ermöglichen, „Wissensstapel“ zu erstellen. Um einen Stack einzurichten, klicken Sie auf „Einfügen Sie Ihren ersten Wissensstapel“ und wählen Sie eine Einbettungsvorlage (Snowflake Arctic Embed wird derzeit empfohlen). Sie können verschiedene Dateitypen (PDF, CSV, JSON) hinzufügen und YouTube-Links integrieren, um eine reiche und gleichzeitig relevante Wissensbasis zu erstellen.

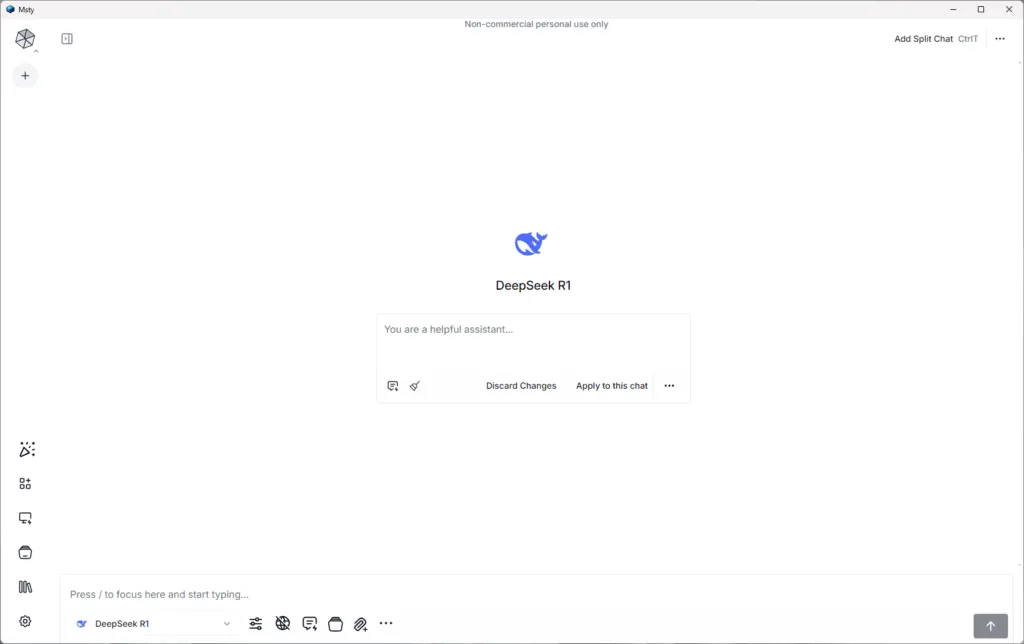

Sobald Sie die lokalen LLM- und Wissensstapel konfigurieren, können Sie mit dem AI-Modell über die intuitive MSTY-Chat-Schnittstelle interagieren. Die Anwendung bietet Funktionen wie Split-Chats und die Fähigkeit, bestimmte Wissensstapel an Gespräche zu befestigen.

Für diejenigen, die auch Online-Modelle verwenden möchten, MSTY ermöglicht es Ihnen, API-Schlüssel für Dienstleistungen wie OpenAI, Gemini und Anthropic hinzuzufügen, bietet Flexibilität bei der Wahl des Modells nach Ihren Bedürfnissen und Datenschutzanforderungen.

Die Schnittstelle umfasst auch erweiterte Funktionen wie “Delve-Modus” und “Context Shield” für eine sichere und anpassbare IA-Erfahrung.